L’adoption de l’AI Act (RIA) a constitué une étape majeure dans la gouvernance européenne de l’intelligence artificielle, en établissant un cadre fondé sur les risques et la protection des droits fondamentaux. Toutefois, les débats récents sur la charge réglementaire, notamment tels que reflétés dans le Rapport Draghi, ont mis en évidence qu’elle est perçue comme un obstacle à la compétitivité et qu’elle engendre des coûts de conformité excessive, en particulier pour les PME et les petites entreprises à moyenne capitalisation, (PEMC).

C’est dans ce contexte que la Commission européenne a présenté, le 19 novembre 2025, la proposition dite « Omnibus numérique ». Celle-ci soulève une question centrale : s’agit-il de simples simplifications ou d’un éloignement plus profond de la logique juridique fondée sur la protection des droits fondamentaux, envisagée en amont lors de l’élaboration du règlement relatif à l’intelligence artificielle ? Parmi les modifications notables figurent l’allègement du régime applicable à certains systèmes à haut risque, le recours aux catégories spéciales de données pour la détection des biais, ainsi que l’évolution des règles relatives aux organismes notifiés et à la certification.

Le Conseil de l’UE a présenté, le 18 février en groupe de travail « simplification », un nouveau compromis sur le volet IA du paquet « omnibus », avant l’ouverture attendue des trilogues. Ce texte confirme une volonté de rationalisation du cadre mis en place par le RIA. Les États membres proposent notamment de reporter à des dates fixes l’entrée en application de certaines obligations relatives aux systèmes d’IA à haut risque. Ils reviennent également sur l’extension envisagée de la base juridique permettant le traitement de catégories particulières de données à caractère personnel pour la détection et la correction des biais. Enfin, le Conseil s’oppose à la suppression de l’obligation d’enregistrement de certains systèmes d’IA dans la base de données de l’Union, privilégiant une logique de simplification plutôt que de suppression.

Ensuite, le 9 mars 2026, durant la dernière réunion du groupe, des nouvelles modifications sont apportées au texte révisé. Ces modifications sont marquées ci-dessous dans la section concernée. Finalement, le 13 mars 2026, le Conseil de l’UE a arrêté sa position sur la proposition, et le 26 mars 2026 le Parlement européen a adopté la sienne sur la proposition par 569 voix pour, 45 contre et 23 abstentions. Les négociations interinstitutionnelles ont été lancées le même jour que l’adoption de la position du Parlement européen et l’objectif est de parvenir un accord final d’ici 28 avril 2026.

Ces évolutions nous invitent ainsi à s’interroger sur la manière dont la recherche de simplification réglementaire pourrait redéfinir l’équilibre initialement établi par le RIA entre innovation technologique et protection des droits fondamentaux.Compte tenu de l’ampleur des modifications envisagées, l’analyse sera scindée en trois parties :

- la première examine les simplifications réglementaires au service de la compétitivité ;

- la deuxième porte sur l’allègement de la régulation envisagé pour les GPAI et IA générative et des affaiblissements des garanties liées aux droits fondamentaux ;

- enfin, la troisième traite de la nouvelle interdiction introduite à l’article 5 du RIA, suivie d’une conclusion générale.

Partie 1: Une simplification réglementaire au service de la compétitivité

Réguler plus tard pour mieux réguler ?

Dans la version initiale de la proposition, l’entrée en application des obligations relatives aux systèmes d’IA à haut risque (SIAHR) devait être liée à la disponibilité des instruments nécessaires à la conformité, tels que les normes harmonisées, les spécifications communes ou les lignes directrices de la Commission. Une fois ces instruments adoptés et confirmés par une décision de la Commission, les obligations auraient été applicables après un délai de six mois pour les systèmes relevant de l’article 6(2) et de l’annexe III et de douze mois pour ceux relevant de l’article 6(1) et de l’annexe I. Dans sa version révisée, le Conseil a toutefois abandonné ce mécanisme conditionnel et a introduit des dates fixes, repoussant l’application des obligations au 2 décembre 2027 pour les systèmes relevant de l’annexe III et au 2 août 2028 pour ceux relevant de l’annexe I. Présentée comme une mesure visant à laisser le temps nécessaire à l’élaboration des normes et à l’adaptation des acteurs, cette évolution conduit néanmoins à retarder de manière significative l’application effective du régime applicable aux systèmes d’IA à haut risque, pourtant au cœur du dispositif du règlement. Ce report soulève ainsi la question de l’équilibre entre l’objectif de simplification et la mise en œuvre effective des garanties prévues pour encadrer les systèmes d’intelligence artificielle les plus sensibles.

Alléger la charge administrative, alléger la protection ? La restructuration de l’Annexe I en question

L’une des modifications les plus structurantes introduites par le Parlement européen concerne la suppression de la section A de l’Annexe I et son intégration à la section B. Il s’agit de réduire les chevauchements réglementaires et de clarifier l’articulation entre le règlement sur l’IA et la législation sectorielle relative aux produits. Cette modification produit un effet ambivalent sur la protection des droits fondamentaux. Si elle renforce la sécurité juridique et réduit les chevauchements normatifs, elle comporte également un risque de dilution de l’approche horizontale du RIA, en particulier en raison du recours accru à des cadres sectoriels qui ne sont pas toujours centrés sur la protection des droits fondamentaux.

Approche par le risque couplée de manière injustifiée à la taille des entreprises

La proposition prévoit un allègement des obligations relatives à la documentation technique (Article 11) et au système de gestion de la qualité (Article 17) pour les fournisseurs de systèmes d’IA à haut risque, notamment au bénéfice des PME et des Petites Entreprises à Moyenne Capitalisation (PEMC) au nom du principe de proportionnalité. Toutefois, cette proportionnalité s’inscrit principalement dans une logique de réduction des charges administratives plutôt que dans une approche centrée sur les droits fondamentaux. Ces simplifications établissent implicitement un lien discutable entre la taille économique de l’entreprise et l’intensité des risques associés aux systèmes d’IA. Or, l’impact d’un système d’IA à haut risque sur les droits fondamentaux ne dépend pas nécessairement de la dimension du fournisseur. Un acteur de petite taille peut tout autant générer des atteintes significatives.

Pour montrer l’important effet de cette simplification il faut premièrement revenir sur la définition de PEMC, notion introduite en 2025 par la Commission européenne afin de soutenir les entreprises en croissance.

« La catégorie des petites entreprises à moyenne capitalisation (PEMC) est constituée d’entreprises qui ne sont pas des petites et moyennes entreprises au sens de la recommandation 2003/361/CE, qui emploient moins de 750 personnes et dont le chiffre d’affaires annuel n’excède pas 150 millions d’euros ou dont le total du bilan annuel n’excède pas 129 millions d’euros. »

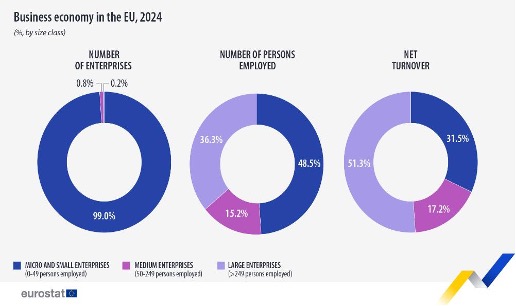

Deuxièmement, comme l’illustre le graphique ci-dessous, étant donné que les PME et les SMC représentent environ 99 % des entreprises dans l’Union, un tel rattachement consacre un régime de conformité inférieur pour la grande majorité de fournisseurs européens de systèmes d’IA.

Source :Eurostat

En matière de documentation technique la modification introduit un formulaire simplifié élaboré par la Commission pour les PME et les PEMC, que les organismes notifiés devront accepter dans le cadre de l’évaluation de conformité. La documentation technique constitue un élément central du contrôle des systèmes d’IA à haut risque, en assurant la traçabilité des choix de conception et de la gestion des risques. Son allègement peut toutefois réduire l’information disponible pour les autorités et compliquer l’identification des risques systémiques, notamment en matière de non-discrimination, de vie privée et de transparence.

Conformité simplifiée au prix de garanties affaiblies ?

La proposition modifie l’article 43 du RIA afin d’aligner les exigences d’évaluation de la conformité sur l’article 16 et de clarifier leur articulation avec la législation européenne sur les produits. Si ces ajustements visent à réduire les redondances et à renforcer la cohérence procédurale, ils soulèvent néanmoins des interrogations au regard des droits fondamentaux. La primauté accordée aux procédures de conformité sectorielles et l’intégration des exigences de l’AI Act dans des dispositifs existants peuvent accentuer une lecture technico-administrative des risques, au détriment d’une analyse substantielle et contextualisée des impacts sur les individus. La modification introduite par le compromis du Conseil de l’UE précise que lorsqu’un organisme d’évaluation de la conformité est déjà désigné au titre de plusieurs législations d’harmonisation de l’Union mentionnées à l’annexe I, section A, il ne doit introduire qu’une seule demande pour être désigné en tant qu’organisme notifié au titre du règlement sur l’IA. Cette clarification confirme l’alignement du régime du RIA sur la logique de la législation européenne relative aux produits. Les organismes déjà désignés au titre d’autres législations d’harmonisation de l’Union pourront être désignés au titre du RIA par une procédure unique, ce qui vise à réduire les charges administratives et à accélérer la mise en œuvre du système de conformité.

Par ailleurs, le dernier compromis du Conseil de l’UE, propose un changement de logique dans le mécanisme de désignation. Alors qu’auparavant les organismes d’évaluation de la conformité devaient être préalablement désignés en tant qu’organismes notifiés pour pouvoir intervenir, le nouveau régime introduit une approche plus flexible. Désormais, ces organismes peuvent, sous certaines conditions, exercer le pouvoir d’évaluer la conformité des systèmes d’IA à haut risque pendant une période transitoire de 18 mois, même en l’absence de désignation formelle. De plus, elle donne la possibilité de soumettre une demande de désignation à tout moment, y compris pendant et après cette période.

Ce changement traduit un passage d’un système fondé sur une autorisation préalable à un mécanisme d’habilitation temporaire. S’il permet d’accélérer la mise sur le marché des systèmes d’IA et de répondre aux contraintes pratiques liées à l’insuffisance d’organismes notifiés, il soulève néanmoins des préoccupations en matière de protection des droits fondamentaux. En effet, l’intervention d’entités non encore formellement désignées est susceptible d’affaiblir les garanties de contrôle et de supervision, ce qui peut affecter la protection effective de droits tels que le droit à la protection des données, le principe de non-discrimination et le droit à un recours effectif.

Une autre modification introduit à la fois un changement terminologique et une précision normative : la notion de « procédure d’évaluation unique » est remplacée par celle de « procédure d’évaluation unifiée » en précisant la procédure d’évaluation unifiée doit être mise en œuvre dans le respect des missions et des responsabilités des autorités impliquées”. Cela exclut toute centralisation des compétences mais ne garantit pas une appréhension holistique des risques, ce qui peut conduire à une invisibilisation des atteintes aux droits fondamentaux situées à l’intersection de plusieurs régimes juridiques. Le Parlement européen a d’une part, supprimé les modifications proposées à l’article 43 du RIA, mais d’autre part, il introduit une restructuration de l’Annexe I qui déplace partiellement le centre de gravité vers les cadres sectoriels. Cette approche traduit une logique de compromis

L’obligation d’enregistrement des SIAHR : suppression ou maintien ?

Le RIA prévoit, à son article 6(4), que les fournisseurs de systèmes d’IA à haut risque relevant de l’annexe III doivent enregistrer ces systèmes dans la base de données de l’Union conformément à l’article 49(2), y compris lorsqu’ils estiment, à l’issue de leur auto-évaluation, que ces systèmes ne présentent pas de risque significatif. La suppression de cette obligation d’enregistrement, justifiée par l’idée que de telles exigences constitueraient une charge disproportionnée en matière de mise en conformité, fragilise toutefois le niveau de protection assuré par le règlement. Une telle suppression porterait atteinte au principe de responsabilité des fournisseurs et affaiblirait la transparence du marché ainsi que la traçabilité de ces systèmes pour le public et les autorités nationales compétentes, en ouvrant la voie à des exemptions injustifiées.

Alors que la proposition de la Commission européenne envisageait de supprimer l’obligation d’enregistrement des systèmes d’IA visés à l’article 6(3) dans la base de données de l’Union, la version révisée par le Conseil de l’UE maintient finalement cette obligation. Le compromis opte ainsi pour une approche plus modérée consistant non pas à supprimer l’enregistrement, mais à en simplifier le contenu en réduisant le contenu exigé dans la section B de l’annexe VIII du règlement afin de réduire la charge administrative pour les fournisseurs. Si cette solution peut sembler pragmatique du point de vue de la simplification réglementaire, elle continue de soulever des inquiétudes du point de vue des droits fondamentaux. En effet, l’article 6(3) du règlement déjà se voit comme une possible « zone grise » du dispositif, dans la mesure où il permet aux fournisseurs de considérer qu’un système relevant de l’annexe III ne doit pas être qualifié de système d’IA à haut risque. Dans ce contexte, la base de données de l’UE joue un rôle essentiel de transparence. Une réduction des informations à fournir lors de l’enregistrement pourrait ainsi limiter la capacité des autorités, des chercheurs ou de la société civile à identifier et analyser certains systèmes susceptibles de présenter des risques. Le Parlement a adopté la même position que le Conseil de l’UE.

Nidal Askar, Doctorante en droit européen de l’Université de Strasbourg, rattachée au centre d’études internationales et européennes (CEIE) et a travaillé au sein du Conseil de l’Europe. Ses recherches portent sur la régulation de l’IA et la protection des données personnelles au niveau européen. Elle a publié des travaux dans ce domaine et le dernier a été publié par European Yearbook on Human Rights 2025 qui porte sur « Le droit a l’oubli à l’ère de l’IA ». Ancienne du Collège d’Europe où elle a fait son master en droit européen, Avocate au Barreau d’Istanbul

Pour (re)lire l‘ensemble de nos posts de cette e-conférence sur les omnibus numériques