Après nous être concentrés, dans nos deux derniers posts, sur le paquet initial de la proposition dite « Omnibus », ce troisième volet est consacré à un nouvel élément introduit par le dernier compromis du Conseil de l’Union européenne du 13 mars 2026, puis repris par le Parlement européen, dans sa position adoptée le 26 mars 2026. Il s’agit d’une nouvelle interdiction introduite à l’article 5 du RIA, visant les systèmes de « nudification » permettant de générer ou de manipuler, grâce à l’IA, des images ou des vidéos à caractère sexuellement explicite ou intime de personnes réelles sans leur consentement.

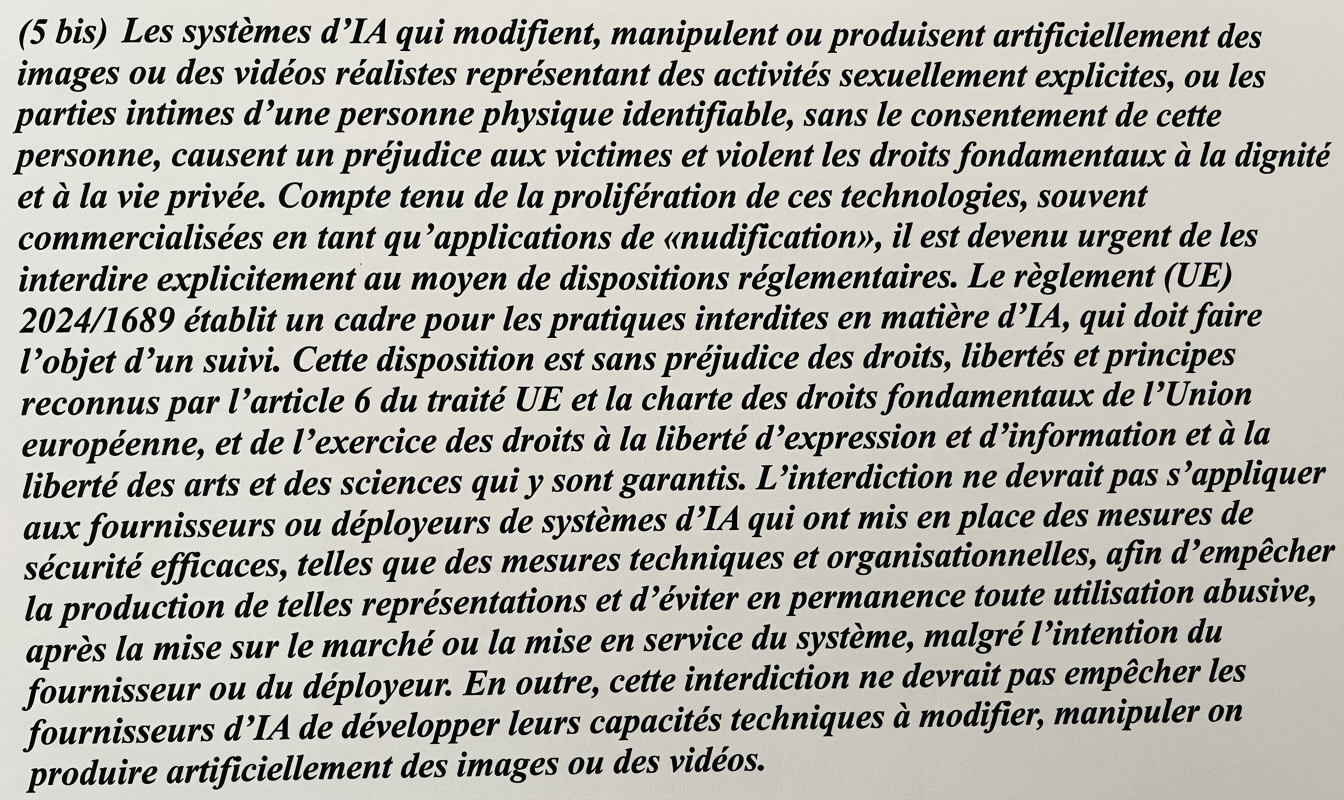

De tels systèmes d’IA, qui modifient, manipulent ou génèrent artificiellement des images ou des vidéos réalistes représentant des activités sexuellement explicites ou les parties intimes d’une personne physique identifiable sans son consentement, causent un préjudice aux victimes et portent atteinte aux droits fondamentaux, notamment à la dignité et au respect de la vie privée. Cette nouvelle interdiction interroge l’évolution du modèle régulatoire.

Une nouvelle interdiction nécessaire mais révélatrice à l’article 5

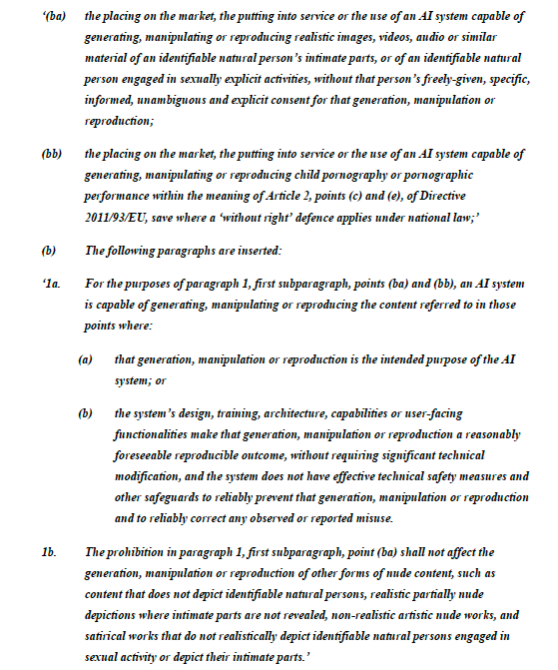

Une nouvelle disposition, qui mérite d’être soulignée, a été introduite par le dernier compromis du Conseil, visant à interdire les pratiques d’IA générant des contenus sexuels ou intimes non consentis, ainsi que des contenus liés aux abus sexuels sur mineurs. Cette disposition a été accueillie favorablement, dans la mesure où elle vise à protéger les mineurs, les femmes, ainsi que, plus largement, les individus contre des pratiques particulièrement abusives.

Cette mesure apparaît, en elle-même, légitime, en ce qu’elle cible des atteintes graves à la dignité humaine et à la vie privée. Elle demeure en outre encadrée, dans la mesure où elle exclut certaines formes de contenus, tels que ceux ne représentant pas des personnes physiques identifiables, les représentations partiellement nues réalistes ne dévoilant pas les parties intimes, les œuvres artistiques non réalistes ou encore les œuvres satiriques. En limitant ainsi son champ aux contenus réalistes impliquant des personnes identifiables et générés sans consentement, le dispositif témoigne d’une volonté d’articuler la protection des droits fondamentaux avec la liberté d’expression.

Toutefois, l’intérêt principal de cette disposition réside dans ce qu’elle révèle de l’évolution du modèle régulatoire. Jusqu’à présent, les interdictions prévues à l’article 5 du RIA reposaient essentiellement sur une logique fondée sur les usages des systèmes d’IA. La nouvelle interdiction introduit, en revanche, une dimension partiellement fondée sur le contenu, en ciblant directement les outputs générés. Cette évolution s’explique par les spécificités de l’IA générative, dont les risques ne peuvent être pleinement appréhendés à travers une approche strictement fondée sur le risque. Dès lors, cette disposition ne constitue pas une rupture, mais plutôt une adaptation du modèle fondé sur le risque face aux transformations induites par l’IA générative.

La comparaison avec la position du Parlement européen met toutefois en lumière une inflexion notable. Alors que le Conseil adopte une approche extensive et techniquement structurée, fondée notamment sur la « capacité » des systèmes à générer de tels contenus, le Parlement privilégie une formulation plus concise et opérationnelle, centrée sur les usages effectifs. Surtout, l’introduction d’une exception fondée sur l’existence de mesures de sécurité effectives transforme la nature même de l’interdiction, qui devient conditionnelle. Or, si ces mesures étaient réellement effectives, la génération de tels contenus ne devrait pas être possible. Le fait qu’ils puissent néanmoins être produits tend dès lors à révéler l’insuffisance de ces dispositifs, ce qui fragilise l’effectivité de l’interdiction.

Ainsi, si l’approche du Parlement vise à préserver l’innovation, la liberté d’expression et la liberté d’entreprendre, elle soulève néanmoins des interrogations quant à l’équilibre opéré, dans la mesure où elle est susceptible d’affaiblir la protection effective de la dignité, de la vie privée et des personnes vulnérables, en particulier des femmes et des enfants.

Cette évolution s’inscrit, enfin, dans un contexte de visibilité accrue des risques liés aux contenus intimes non consentis générés par l’IA, qui ont récemment émergé comme un sujet central du débat public. La diffusion rapide d’outils d’IA générative accessibles au grand public a facilité la production de contenus de type « nude fake », contribuant à banaliser ces pratiques. Cette problématique a récemment trouvé une illustration concrète dans la jurisprudence nationale néerlandaise. Ainsi, un tribunal d’Amsterdam a interdit à la plateforme X et à son assistant d’IA Grok de générer et de diffuser des images dénudant des personnes sans leur consentement, ainsi que du contenu pédocriminel. Offlimits, un centre d’expertise néerlandais sur les violences en ligne, a engagé des poursuites contre les plateformes en raison d’une fonctionnalité de Grok permettant de créer des deepfakes hyperréalistes de femmes et d’enfants. Malgré les affirmations des opérateurs selon lesquelles des mesures de sécurité avaient été mises en place, le juge a estimé qu’il existait un doute raisonnable quant à leur efficacité. De leur côté, X et son entité irlandaise chargée des opérations européennes se voient interdire de proposer le chatbot Grok tant que ces violations persistent, chaque injonction étant assortie d’une astreinte de 100 000 euros par jour, plafonnée à 10 millions d’euros.

Cette affaire fragilise un argument classique avancé par les fournisseurs de modèles et de systèmes d’IA, fondé sur la prétendue neutralité de l’outil et la responsabilité exclusive de l’utilisateur final en cas de mésusage. Le tribunal d’Amsterdam rejette explicitement cette ligne de défense, en retenant la responsabilité du fournisseur dans la prévention de tels contenus. Il met en outre en évidence une contradiction entre l’affirmation selon laquelle certaines générations seraient techniquement impossibles et l’argument selon lequel une conformité totale ne pourrait être garantie. Cette décision illustre de manière particulièrement éclairante les limites d’une approche fondée sur les seules garanties techniques et confirme que la simple existence de mesures de sécurité ne suffit pas à prévenir effectivement la production de contenus illicites. En outre, la Commission européenne a déjà ouvert une enquête au titre du Digital Services Act (DSA) afin de vérifier si X a correctement géré les risques liés aux deepfakes sexuels. Ce problème est apparu fin 2025, après l’ajout de fonctions de génération d’images dans Grok, qui se sont rapidement propagés. En quelques jours seulement, des millions d’images sexualisées ont été produites, dont certaines impliquant des mineurs. Ainsi, cette problématique dépasse par ailleurs la seule dimension technique des systèmes d’IA. Certaines informations récentes suggèrent que les controverses liées à la génération de contenus intimes non consentis pourraient également s’inscrire dans des logiques économiques et stratégiques. Ainsi, le parquet de Paris a signalé aux autorités américaines des éléments susceptibles de révéler une valorisation artificielle des sociétés liées au système Grok, dans un contexte de forte médiatisation des capacités de génération de contenus sexualisés. Sans préjuger du bien-fondé de ces allégations, ces éléments mettent néanmoins en évidence un point essentiel : les incitations économiques des acteurs peuvent entrer en tension avec les exigences de prévention des risques. Dès lors, une approche reposant exclusivement sur la mise en place de garanties techniques apparaît insuffisante, ce qui renforce la nécessité d’un encadrement juridique effectif.

En définitive, tous ces développements ont ainsi joué un rôle déterminant dans la prise de conscience des risques associés à l’IA générative et ont renforcé la nécessité d’un encadrement juridique explicite.

Conclusion :

L’objectif principal de l’AI Act est de protéger les droits fondamentaux, la santé et la sécurité face aux risques liés aux systèmes d’IA. Or, alors que les obligations applicables aux systèmes d’IA à haut risque ne sont pas encore pleinement en vigueur, la proposition risque d’en fragiliser la logique protectrice. Certes, la version de compromis du Conseil tente de clarifier certains mécanismes, notamment en fixant des dates d’application plus prévisibles pour les obligations relatives aux systèmes d’IA à haut risque. Toutefois, ces reports successifs illustrent également une évolution plus large de l’approche européenne, dans laquelle la recherche de simplification et de compétitivité tend à prendre une place croissante. La position du Parlement introduit toutefois une inflexion partielle, en réaffirmant, dans certaines dispositions, l’exigence d’un encadrement plus rigoureux et d’un contrôle renforcé, ce qui atténue, sans toutefois les dissiper entièrement, les risques d’affaiblissement de la logique protectrice initiale du règlement. D’ailleurs, l’introduction de l’interdiction des pratiques d’IA générant des contenus sexuels ou intimes non consentis, ainsi que des contenus liés aux abus sexuels sur mineurs constitue un outil important pour la protection de la dignité des individus face aux risques émergents liés à l’intelligence artificielle générative. Toutefois, dans la version retenue par le Parlement européen, cette interdiction se trouve partiellement atténuée par l’introduction d’exceptions fondées sur l’existence de mesures de sécurité, ce qui soulève des interrogations quant à son effectivité réelle et contribue à fragiliser, sur le plan normatif, la cohérence du cadre juridique du RIA. Dès lors, ces évolutions en général témoignent d’un infléchissement progressif du cadre normatif de l’Union, dans lequel l’objectif initial du RIA, à savoir garantir une intelligence artificielle digne de confiance, fondée sur des garanties robustes, une sécurité juridique effective et une protection élevée des droits fondamentaux tend à s’effacer au profit d’une logique accrue de simplification et de compétitivité.

Nidal Askar, Doctorante en droit européen de l’Université de Strasbourg, rattachée au centre d’études internationales et européennes (CEIE) et a travaillé au sein du Conseil de l’Europe. Ses recherches portent sur la régulation de l’IA et la protection des données personnelles au niveau européen. Elle a publié des travaux dans ce domaine et le dernier a été publié par European Yearbook on Human Rights 2025 qui porte sur « Le droit a l’oubli à l’ère de l’IA ». Ancienne du Collège d’Europe où elle a fait son master en droit européen, Avocate au Barreau d’Istanbul

Pour (re)lire l‘ensemble de nos posts de cette e-conférence sur les omnibus numériques